继Twitter大裁员之后,埃隆·马斯克又被“顶上了枝头”。

作为热搜大热门,这次埃隆·马斯克瞄准的目标是最近大火的人工智能AI。包括图灵奖得主约书亚·本吉奥,以及苹果联合创始人史蒂夫·沃兹尼亚克在内的超千名专家学者联合发布了一封公开信,强烈呼吁全球所有机构暂停训练比GPT-4更强大的AI至少六个月,并利用这六个月时间制定AI安全协议。

这封各界大佬联名抵制的公开信一经发布,在中国的互联网上立即炸开了锅,各路媒体纷纷报道。抛开公开信本身的真假不论,其发布所引起的震撼与讨论,却值得深思。

01 AI威胁论,是否空穴来风?

“我们应该让机器用宣传和谎言淹没我们的信息渠道吗?我们是否应该把所有的工作都自动化掉,包括那些使人有成就感的工作?我们是否应该发展非人类思维,让它们最终在数量上、智力上超过我们、淘汰并取代我们?我们是否应该冒险失去对我们文明的控制?”

——内容来自《公开信》

正如信中所诘问的那样,这封公开信,措辞激烈地再三强调高级人工智能正在对人类社会造成威胁,在各大AI实验室火力全开的竞争之余,却没有足够的措施来确保AI的开发研究不会侵害人类安全与伦理道德。

那么,这样的言论是否是空穴来风,言过其实呢?

事实上,关于AI所带来的的负面影响的担忧由来已久,自2014年以来,联合国就针对致命自主武器系统的开发进行了国际辩论。近日,国内几起由AI换脸或AI换装引发的恶性事件屡登热搜,更进一步引起了人们的关注。

在国内男网红特效合成师洪某因AI换脸与迪丽热巴亲吻,自食恶果被迪丽热巴粉丝抓伤“破相”事件发酵之前,国外前美国总统特朗普还未被捕,其“被捕”甚至“越狱”的AI合照就已在一些社交平台流传开来,且仅凭肉眼难辨真假。

在惊叹AI技术的强大之余,我们也不得不承认,AI的快速发展使造谣变得更加便利、更有迷惑性。

这也就不难理解,欧洲刑警组织在最新科技报告中指出,ChatGPT等AI驱动的聊天机器人或被滥用于发动网络钓鱼攻击、散布虚假信息和实施网络犯罪。

毕竟,ChatGPT所具有的起草高度现实文本的能力,以及其可复制语言模式的能力,足以使其以假乱真地冒充特定个人或团体的讲话风格,而这一性能一旦被犯罪分子利用,后果令人担忧。

02 没有科学的监管,AI何以良性发展?

“人工智能的研究和开发应该重新聚焦于优化最先进的系统,让它更加准确、安全、可解释、透明、稳健、一致、值得信赖、对人类忠诚。与此同时,AI开发人员必须与决策者合作,大力推进强有力的AI治理系统的发展。这个系统至少应包括:针对AI的新型监管机构;对高能力AI系统的监督追踪和大型算力池;帮助区分真实数据与AI生成的数据、并且追踪模型泄漏的溯源和水印系统;健全的审计和认证生态系统;对AI造成的损害定责;为AI技术安全研究提供强大的公共资金;应对AI可能会引发的巨大经济和政治动荡(尤其是对民主的影响)有充足资源的机构。”

——内容来自《公开信》

这封公开信引发我们思考的另一个点,在于对AI的监管是否必要?是否迫在眉睫?

有句话说:“走太快了,灵魂跟不上。”AI技术同样如此。在人工智能以前所未有,甚至是发明者们所未曾预料的速度发展的当下,我们应当考虑到AI的发展是否仍在人类的掌控之中?它迅猛发展的结果,是否会与我们的本心背道而驰?(如果我们的本心是促进科技与世界发展,而非仅仅获取暴利。)

如果我们对此有一丝疑惑,正如OpenAI最近在关于通用人工智能的声明中所表示的那样,“到了某个时间节点,在开始训练新系统之前,进行独立审查可能很重要,而用于新模型的计算的增长速度也应加以限制。”

那么,在放任AI的发展逐渐脱离轨道之前,我们是否应该就AI安全达成一些共识,并共同开发和实施一套针对高级人工智能设计和开发的共享安全协议呢?

值得关注的是,就在呼吁达成协议的公开信发布的当天(3月29日),英国发布了首份人工智能监管白皮书。该白皮书不仅概述了针对ChatGPT等人工智能治理的五项原则,还提出了英国监管人工智能的方法,并表示英国政府将设置一个新的监管沙盒。

英国在发布白皮书的同时,还明确表示人工智能将是其未来重点发展的五大技术之一,白皮书的发布是为了通过科学监管的形式帮助企业在AI领域能良性发展,支持创新者将新想法推向市场。

03 公开信,是一场阴谋论还是责任感?

有意思的是,这封由生命未来研究所(FLI)于昨天发布在官方网站上的公开信,除了引发我们对AI威胁与监管的讨论之外,网友们对公开信本身的发布意图也呈现了两极分化观点。

一种观点力挺公开信,着重强调了安全协议的必要性。

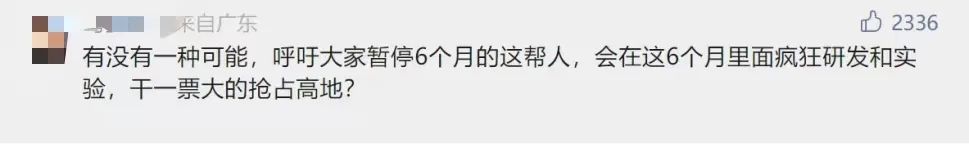

另一种观点则认为,在AI发展如火如荼的当下,这封公开信的发布,里面强烈要求的6个月空窗期,让人不得不怀疑是否是一场阴谋论,是否是“有心人”的一场心机表演。

是否只是为自家关于AI的研发拖延时间?

事情的真相我们暂时不得而知。

但是,我们却明白一个朴素的道理,科技的发展如果失去了规则的制约,后果将是我们无法承受的。我们期待人工智能AI的发展能带来新的技术革命,更大程度上将人类从初级琐碎的劳动中解放出来,从而能够将更多的精力放在更有意义和价值的地方。

但另一方面,我们也期待针对人工智能AI的发展和应用,能有更健全的机制和制度进行监督和约束,最大范围地保证人工智能向善发展。

04 监管应是多方责任,你我皆有份!

公开信中谈到,“AI开发人员必须与决策者合作,大力推进强有力的AI治理系统的发展。”

诚然,要使AI向善发展,真正服务于人类,离不开AI开发平台与决策者的责任感与协同合作。

AI的发展,

需要AI开发平台承担主体责任,建立并完善自我监管的内容;

需要国家监管部门建立完善的监管系统,并加强监督检查,这不仅仅面向AI开发平台,也应该面向那些利用AI作恶之人。

同时,我们普通人也要承担起自身的责任,在合理规范使用AI的同时,对猎奇、“劲爆”的内容要保持足够的理性和警惕,在面对“AI犯罪”等行为时,要懂得留存证据,合理维权。

人类可以和AI共创繁荣未来。为了这个美好的未来,我们将为此共同努力,你我皆有份!

如果你有领域优秀项目,请扫描官方客服二维码,并发送BP至邮箱pegasuschina@pegasusventures.com.cn联系我们!